Ga het gesprek aan met je data met TimeXtender MCP!

Misschien ken je het wel. Je hebt een vraag en een dashboard met 40 visuals, maar het antwoord staat er niet tussen. De gebruikelijke weg is dan om een change aan te vragen bij de BI-afdeling. Tegen de tijd dat deze is opgeleverd, is je vraag soms al achterhaald.

Dus maak je zelf een download uit het dashboard en bouw je in Excel je eigen analyse.

Wat als dit tot het verleden zou behoren? Wat als je de mogelijkheid hebt om je businessvragen rechtstreeks te stellen aan een chatbot zoals ChatGPT of Claude?

Eind januari 2026 deed ik mijn eerste ervaring op met TimeXtender MCP. MCP (Model Context Protocol) vormt een brug tussen een Large Language Model (LLM) en jouw semantisch datamodel.

Installatie en eerste inrichting

Voor deze test heb ik een aparte virtuele machine ingericht met TimeXtender en de Microsoft Adventure Works demo-dataset. Zo kon ik onafhankelijk testen zonder impact op een productieomgeving.

TimeXtender MCP wordt momenteel nog als preview aangeboden en wordt apart geïnstalleerd. De installatie zelf was eenvoudig en binnen enkele minuten afgerond. Tijdens de configuratie geef je aan waar de server draait en welke semantic endpoint(s) beschikbaar worden gesteld.

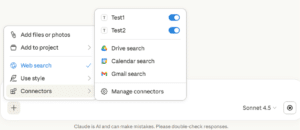

Voor deze proefopstelling heb ik gekozen voor Claude, de AI-assistent van Anthropic. MCP kan met meerdere LLM’s koppelen, maar Claude heeft een eigen configuratietab, wat de aansluiting eenvoudig maakt.

Binnen TimeXtender heb ik een semantic endpoint aangemaakt, vergelijkbaar met de manier waarop je een endpoint inricht voor Power BI, Qlik of Tableau. Vanuit de MCP-configuratie wordt vervolgens een Windows service opgezet die het datamodel beschikbaar maakt voor de AI-assistent.

De totale inrichting bestaat daarmee uit drie componenten:

- 1. Het semantische model voor MCP in TimeXtender,

- 2. De MCP-service die het model beschikbaar maakt,

- 3. De koppeling met de AI-assistent (Claude).

Waarom vragen stellen aan een datamodel anders is

De kracht van deze assistent is dat je niet vragen stelt aan een database, maar aan een datamodel. De assistent kent de onderlinge relaties en begrijpt de meegegeven business logica, ook al ziet hij deze voor het eerst.

Als je een vraag stelt (aan Claude in dit geval), zie je dat hij supersnel SQL-queries schrijft en daarmee het model bevraagt. Technische kennis van tabellen of query’s is niet nodig. Dit maakt het stellen van vragen laagdrempelig, terwijl de antwoorden in lijn blijven met het datamodel.

De resultaten worden gepresenteerd in een overzichtelijke HTML-weergave met visualisaties, vaak aangevuld met contextuele toelichting.

Vragen stellen in praktijk

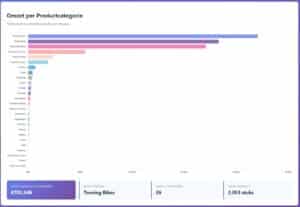

Ik startte met een simpele vraag: wat was de omzet dit jaar? Dit was het resultaat.

Daarna heb ik de complexiteit opgevoerd en vroeg ik om een Pareto-analyse. Wat je terugkrijgt is niet alleen een cijfer, maar meerdere visualisaties mét context.

Vervolgens heb ik om een regressieanalyse gevraagd en andere statistische uitdagingen getest. Zonder dat ik zelf een measure hoefde aan te maken of een query hoefde te schrijven, kreeg ik een gestructureerd antwoord gepresenteerd.

Het antwoord leek te kloppen, al heb ik het niet tot op de komma nagerekend. Wat vooral opvalt, is dat de stap van vraag naar analyse zeer klein wordt.

Werken met meerdere modellen

Iets wat ik nog wilde testen, is of MCP kan omgaan met meerdere semantic endpoints. Dit blijkt mogelijk.

Voor mijn test heb ik een tweede model gemaakt en dit gekoppeld. Vervolgens heb ik vragen gesteld waarbij Claude duidelijk kon toelichten wat de verschillen waren tussen de twee modellen.

Dit opent interessante mogelijkheden. Je zou per gebruikersgroep of per bedrijfsproces een aparte assistent kunnen inrichten met een eigen set aan datamodellen. De context blijft gescheiden, terwijl de interactie voor de gebruiker gelijk blijft.

Wat kan er (nog) niet?

De mogelijkheden zijn breed. Toch zijn er duidelijke beperkingen.

MCP is geen platform voor machine learning of modeltraining. Simulaties en het trainen van nieuwe modellen worden niet ondersteund. Analyses worden uitgevoerd op basis van het bestaande datamodel. Voor specifieke bewerkingen kan eventueel een ander MCP, zoals dat van Qlik, worden ingezet.

Een belangrijker aandachtspunt is security.

In mijn testomgeving werd Row Level Security (RLS) nog niet toegepast. De assistent herkent niet automatisch dat mijn Claude-gebruiker en mijn TimeXtender-gebruiker dezelfde persoon zijn. Daardoor kan het volledige model worden bevraagd, ongeacht eventuele toegangsrestricties.

Voor gebruik in een productieomgeving is dit een essentieel punt dat goed moet worden ingericht.

Het belang van context

Je kunt het model, en daarmee de assistent, verfijnen door extra context toe te voegen. In TimeXtender doe je dit eenvoudig door bij measures en velden duidelijke beschrijvingen op te nemen.

Bijvoorbeeld: in de beschrijving van de measure ‘omzet’ leg je vast dat omzet altijd wordt weergegeven in euro’s. De assistent neemt deze context mee bij het interpreteren van vragen en het genereren van antwoorden.

Hoe beter definities en context in het model zijn vastgelegd, hoe consistenter de uitkomsten zullen zijn. Een goed onderhouden semantisch model wordt daarmee een belangrijke randvoorwaarde voor het verantwoord inzetten van AI binnen BI.

Conclusie en vooruitblik

Mijn eerste ervaring met de previewversie van TimeXtender MCP laat zien hoe snel de interactie tussen AI en BI zich ontwikkelt. De gegenereerde output is overzichtelijk en goed vormgegeven, maar belangrijker is dat de antwoorden aansluiten op het onderliggende datamodel.

Tegelijkertijd zijn er nog aandachtspunten, met name op het gebied van security en gebruikerscontext. Voor inzet in een productieomgeving zijn dit essentiële randvoorwaarden.

Wat deze ontwikkeling vooral laat zien, is dat de behoefte van de business verandert. Er is vraag naar directe antwoorden op ad-hoc vraagstukken, zonder dat daarvoor eerst een nieuw dashboard of een aanvullende visual hoeft te worden gebouwd. MCP biedt een manier om die vragen te beantwoorden binnen de bestaande businesslogica van het model.

Voor BI-teams betekent dit niet dat hun rol kleiner wordt, maar anders. Minder tijd zal gaan naar losse ad-hoc verzoeken en meer naar het zorgvuldig inrichten en onderhouden van semantische modellen. Het toevoegen van duidelijke definities en context wordt daarmee nog belangrijker.

De focus verschuift van rapportage naar het zorgvuldig ontwerpen en beheren van het datamodel.

Uiteindelijk bepaalt niet de assistent, maar de kwaliteit van het model hoe waardevol de antwoorden zijn. En wie het model op orde heeft, kan het gesprek met data echt aangaan.

Contact

Wil je verkennen wat ontwikkelingen als TimeXtender MCP op termijn voor jouw organisatie kunnen betekenen?

E-mergo helpt organisaties bij het ontwerpen en inrichten van semantische modellen die klaar zijn voor de volgende stap in BI. Neem gerust contact met ons op om samen de mogelijkheden te verkennen.

Blijf op de hoogte

Wil je geen blog missen? Schrijf je dan in voor onze nieuwsbrief. Zo ontvang je elke maand alle nieuwste content direct in je mailbox. Je kunt je inschrijven via de knop hieronder.

Geschreven door Juriaan Hensbroek

Senior BI Consultant